Apple zdradza szczegóły dotyczące działania sztucznej inteligencji w głośniku HomePod

W najnowszej publikacji na blogu Machine Learning Journal, Apple opowiada o tym, jak wykorzystanie sztucznej inteligencji pomaga w rozpoznawaniu komend głosowych w przepełnionym różnymi dźwiękami i zakłóceniami otoczeniu.

Głośnik HomePod jest w stanie uruchomić Siri nawet, gdy użytkownik stoi od niego w dalszej odległości, a także podczas odtwarzania głośnej muzyki. Wpis na blogu Apple jest skierowany przede wszystkim do inżynierów i naukowców, którzy na co dzień zajmują się wdrażaniem sztucznej inteligencji do rozmaitych urządzeń.

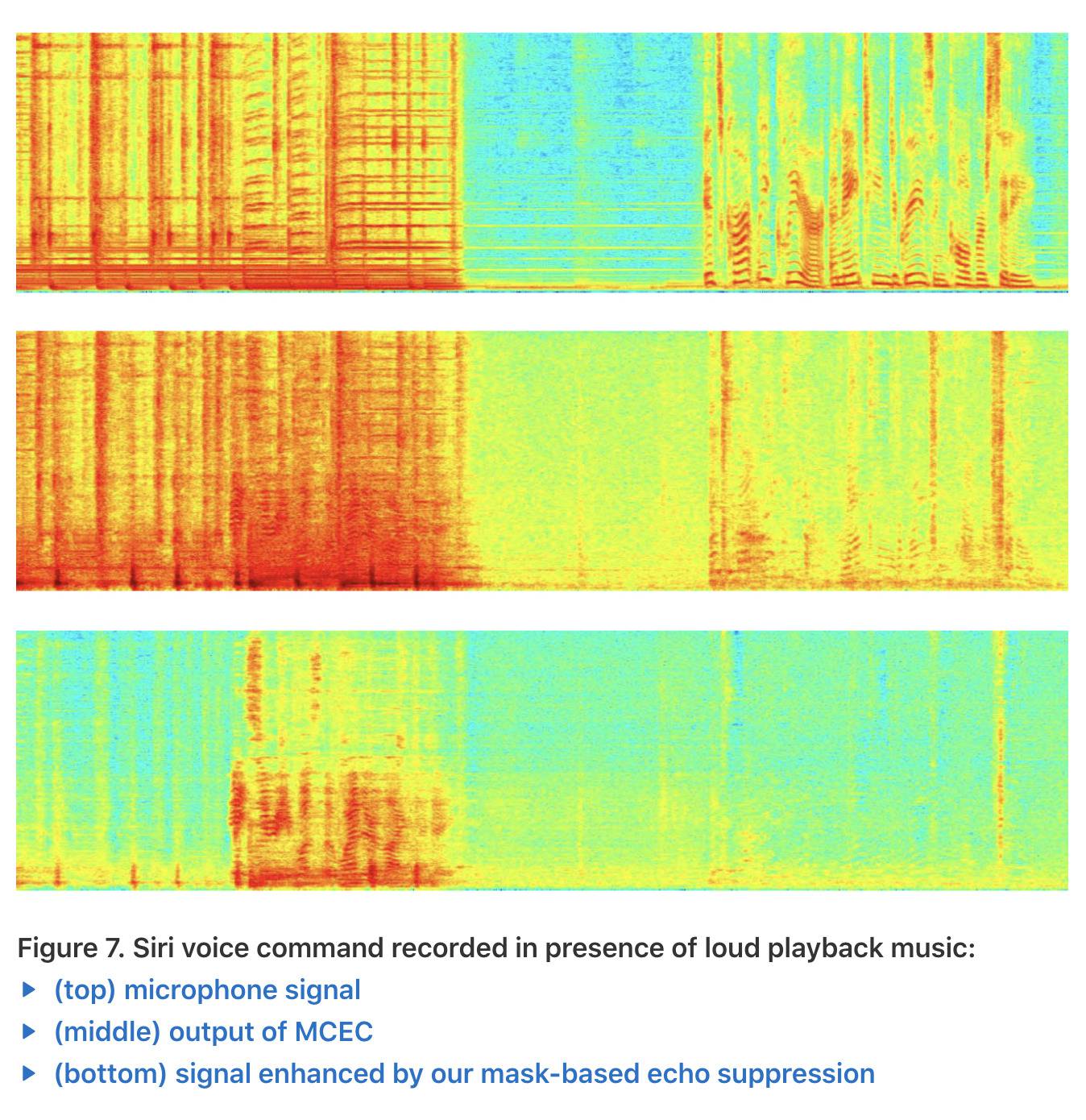

HomePod działa w oparciu o wielokanałowe filtrowanie, które ma za zadanie wyeliminować echo i hałas w tle. Na zdjęciu przedstawione są warstwy dźwięku, jakie widzi głośnik podczas wywołania komendy głosowej Siri. Na samej górze znajduje się sygnał z mikrofonu. Pod nim widać wielokanałową redukcję szumów generowaną przez algorytm. Na samym dole znajduje się maska oparta na systemie redukcji echa. HomePod skupia się wyłącznie na osobie wywołującej komendę "Hey Siri". Jak widać zaawansowane algorytmy są w stanie poradzić sobie nawet w bardzo trudnych warunkach, gdy kilka różnych dźwięków nakłada się na siebie.

W artykule znajduje się sporo wyliczeń i wzorów dokładnie wyjaśniających działanie systemu. Według Apple system rozpoznawania mowy wykorzystuje mniej niż 15 proc. pojedynczego rdzenia procesora A8 osiągającego taktowanie 1,4 GHz.

Publikacja zawiera też przykłady prezentujące działanie sztucznej inteligencji. Na poszczególnych nagraniach można usłyszeć jak dużo pracy wykonuje przetwarzanie dźwięku, aby można było usłyszeć głos użytkownika wywołującego Siri.

Źródło: Apple